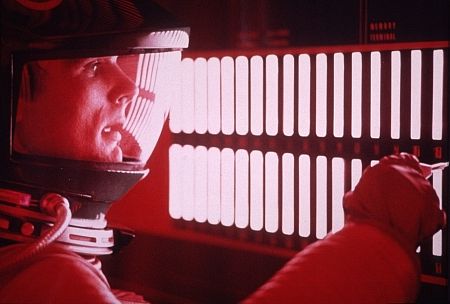

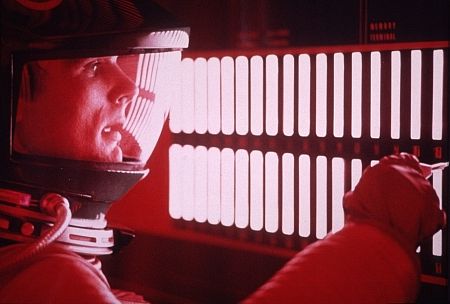

Dans 2001 Odyssée de l’espace, la conversation finale entre l’homme et Hal, l’intelligence artificielle, ne passe pas par un écran, des diodes, un visuel plan souvent et rarement holographique, mais par la voix fût-elle synthétique.

Dans 2001 Odyssée de l’espace, la conversation finale entre l’homme et Hal, l’intelligence artificielle, ne passe pas par un écran, des diodes, un visuel plan souvent et rarement holographique, mais par la voix fût-elle synthétique.

Si depuis les années 80, en débutant l’histoire avec le PC - même si l’écran de cinéma et le petit écran de la télévision ont converti les masses depuis bien plus longtemps - l’écran se décline dans toutes les tailles et des épaisseurs de plus en plus fines, s’équipant d’une sensibilité tactile et par conséquence ouvre les voix de l’intelligence. Cet écran favorise l’image, unique ou fragmenté, ainsi que le texte, l’écrit. La conversation demeure épistolaire. Les textos sont des télégrammes.

L’avenir de la conversation avec les machines risque de quitter l’écran pour rejoindre le régime de conversation le plus universel et le plus fondamental : la vocalise. Le premier des médias, avec la lumière, c’est une onde qui parcourt l’air. Une vague qui s’élance des lèvres pour faire vibrer l’oreille interne puis être convertie en crépitement électrique dans les réseaux du cortex. Babiller. Parler. Il faut à un humain guère plus de 2 ou 3 ans pour s’y mettre. Et encore, l’art des vagues peut ne rien dire et se concentrer sur la forme même de l’onde, c’est la musique et ses langues.

De manière plus prosaïque, les technologies nouvelles du #deeplearning en permette de nouveaux développement, à l’instar de la technologie Wavenet proposé par une des filiales d’Alphabet - DeepMinds ( et on recommande de lire tout le post et même la publication).

L’application la plus évidente est naturellement celles des livres parlants, de l’audio description pour aider les mal-voyants. Le vaste marché des centres d’appel et de relation client est concerné au premier titre, car automatiser une grande partie de la tâche par des agents conversationnel (incarnés dans une voix plutôt qu’une image) promet des gains de productivités considérable. On peut l’élargir sans hésiter à l’ensemble des ATM et autres bornes interactives. Ces technologies concerne aussi les médias où l’on imagine des bulletins de nouvelles et de météo générés par des intelligences virtuelles et lues à la radio par des speakers synthétiques. Mais surtout, il y a deux vastes marchés potentiels où l’interface fondamentale est liée au son et la voix. Il s’agit de manière évidente celui des autos et autres véhicules autonomes. C’est le moyen de donner au passager un moyen de contrôle de l’ IA qui le conduit, ne serait-ce que lui ordonner de s’arrêter - bref un safeword. L’autre est plus proche de nous , c’est celui- des interfaces telles que Echo d”Amazon , Siri de Apple, ou son analogue Everywhere chez Google. Parler est souvent le moyen le plus simple de commander. Ce type d’ interface a vocation à s’enrichir, ne serait-ce que par la coordination des objets connectés au domicile ( ordonner par son intermédiation la température souhaitée de la pièce). Il y a encore bien d’autres marchés, c’est une question d’imagination. Le point essentiel c’est de comprendre que les interfaces audios représentent un espace encore inexploré : pour demander qu’on nous passe le sel, on ne s’envoie pas de texto, on vocalise. L’informatique d’hier fonctionne au doigt et à l’oeil, celle du futur proche aura des lèvres et des oreilles.

PS : cette petite note a été suscitée par des questions d’Atlantico à propos de WaveNet. Elle rejoint d’autres interviews dans le même titre et des sujets similaires :

-

Siri, c’est fini: les chatbots, ces programmes qui seront vraiment capables d’avoir des conversations avec les êtres humains

-

Et maintenant, des machines qui apprennent toutes seules : ces mille et une petites révolutions que prépare Google dans son centre de recherche de Zurich

-

Révolution épicière : Amazon va-t-il tuer tous les petits commerces de proximité avec sa livraison de produits frais à domicile ?

-

Apple a un plan pour conquérir nos maisons et voilà par où ça va commencer

Un cours et un projet

Un cours et un projet

Dans 2001 Odyssée de l’espace, la conversation finale entre l’homme et Hal, l’intelligence artificielle, ne passe pas par un écran, des diodes, un visuel plan souvent et rarement holographique, mais par la voix fût-elle synthétique.

Dans 2001 Odyssée de l’espace, la conversation finale entre l’homme et Hal, l’intelligence artificielle, ne passe pas par un écran, des diodes, un visuel plan souvent et rarement holographique, mais par la voix fût-elle synthétique.