Faut-il relocaliser l’industrie textile ? Pas vraiment si on considère la localisation de la valeur ?

Marketing, Cultures et Technologies

Il est délivré principalement à la Licence 3 d’économie et gestion, des licences humanités digitales et du Master 1 de marketing.

Le support de cours est ici.

L’évaluation pour la promotion de licence est là. On ne peut y accéder que si on est connecté sur G-Suite avec son adresse de Nanterre.

L’examen des M1 est là.

Longtemps que je ne me suis plus intéressé au blog, il est temps d’y revenir. Le temps est beau dans le confinement.

Pour relancer l’affaire autant republier la belle réalisation du salon de la relation client de l’ouest qui m’a invité avant le confinement. C’est une leçon que j’ai déjà donnée, mais là qui est mise en image intelligemment et je n’y suis pour rien. Merci à mes amis de l’Amarc qui ont permis cette production. Ça parle de KPI, de contrôle de gestion et d’une perspective plus anthropologique. Le rituel des nombres.

Ça peut être à l’occasion le motif d’un cours, merci à @marcbidan et à ses étudiants d’avoir testé cette version.

Merci!

PS : c’est un remake

🙂

Ce cours de comportement du consommateur sera dispensé à distance. Deux éléments le constituent :

Des présentations faites in vivo lors de la première séance, les présentations donnée sous forme de webinaire (On utilise zoom via #aunège)

Un travail d’analyse qui consiste à étudier une application qui concerne directement ou non, le monde de l’assurance.

Il est demandé aux étudiants :

De constituer un corpus de commentaires d’utilisateur de l’appli (les 50 derniers qui ont un score d’utilité >1), en ajoutant les éléments sur le tableau suivant.

De rédiger une note de synthèse, dont le modèle est accessible ici.

Rendez- vous

Le formulaire pour transmettre les réponses au contrôle est disponible ici.

Il sera accessible jusqu’au 23 décembre minuit.

Attention : le lien a été mis à jour le 6/11 à 14h50. Les invitations envoyées avant cette heure ne sont plus valable, les étudiants devront se reconnecter pour mettre leurs réponses à jour, en revenant sur ce lien

Tous les voyages ne sont pas ratés comme ceux qu’étudie Jean-Didier Urbain, et celui que je viens de vivre, sans prétendre au succès, est une étape accomplie. Un double voyage, physique d’abord, car rejoindre ce bout de France antipodique demande l’effort de se perdre dans le temps et dans l’espace, la Polynésie s’apprécie d’abord en regardant les cartes et en lisant l’histoire, séparant les cartes postales et les clichés, pour décrypter dans un continent océanique, le flux et le reflux des cultures, et un voyage mental ensuite quand on peut observer l’objet des observations qu’on veut analyser : les commentaires des internautes, le discours des touristes. Trianguler en quelque sorte et découvrir après leurs mots, l’objet de leur expériences et ceux qui en sont absents ( par exemple le mot pirogue, qui est le sport national, est quasi absent du corpus).

Le but de ce voyage était de faire un point d’étape sur un projet engagé au sein du Centre d’Etudes du Tourisme en Océanie-Pacifique, dont le but pragmatique conduit cependant à de nombreuses questions. Le but est simple : comment analyser les données produites par des dispositifs de crowdsourcing, les commentaires produits par les touristes sur des plateformes telles que TripAdvisor, Twitter, Booking, Airbnb, Expedia, Facebook ou Instagram, et quels enseignements en tirer. Il s’inscrit dans la perspective de l’étude de la satisfaction des consommateurs, l’analyse automatique et massive du texte permettant de construire des indicateurs de sentiments, d’émotion et de sujets de discussion, susceptibles de compléter voir de suppléer aux enquêtes par questionnaires traditionnelles, pour informer en continu les responsables d’activités économiques et sociales liées au tourisme qui représentent 11% de l’économie polynésienne.

A cette étape du projet les questions sont surtout méthodologiques. Comment extraire les données, comment constituer les corpus, comment analyser ce texte.

Pour la première question c’était l’occasion de rencontrer le groupe d’étudiants de licence dirigé par Sébastien Chabrier qui ont réfléchi et développé un programme de scrapping en php. Au-delà de la technique de collecte se pose naturellement des questions légales et éthiques : si ces données présentent peu de caractères personnels et ont une finalité de lecture publique, des problèmes de droit d’exploitation à fin de recherche peuvent se poser. L’éclairage des juristes sera nécessaire.

Pour celle de la constitution des corpus, on découvre peu à peu qu’une seule source n’est pas suffisante. Sur TripAdvisor les consommateurs se conforment à l’injonction et évaluent les hôtels uniquement, on y trouvera peu d’éléments pour apprécier leur expérience subjective du voyage, ils s’en tiennent à des aspects matériels et fonctionnels liés aux conditions d’hébergement. Les réseaux sociaux sont une source plus pertinente pour cet aspect, mais le suivi de certains acteurs - par exemple les commentaires sur les excursionnistes - pourrait être bien utiles. Un outil de collecte, outre son aspect technique et informatique (API et scrapping), doit suivre un plan raisonné de constitution d’un corpus à partir de plusieurs sources.

Sur le plan de l’analyse des données, le principal résultat obtenu est que pour assurer un traitement des données correct, le pré-traitement est une étape cruciale. La solution que nous avons adopté consiste à lemmatiser les mots, à identifier leur formes morphosyntaxiques et les dépendances syntaxiques qui les unissent. On réalise cette étape avec les ressources de CleanNLP et du “Part Of Speech”. Elle permet de nettoyer le texte et d’obtenir des solutions lisibles d’analyse de topics par la méthode LDA et d’approfondir les détails sémantiques (par exemple identifier les qualificatifs de certains objets et concept : hôtel, chambre, alimentation, environnement… Un développement important sera, par la nature des données, de compléter par une meilleure annotation des entités nommées (noms des iles, des établissements, des personnes). Plus généralement l’amélioration de cette étape passe par le développement d’index et de lexiques spécifiques et sans doute d’exploiter d’autres ressources telles que le remarquable Atlas Linguistique de la Polynésie Française.

En confrontant les acteurs aux données, nous avons eu le plaisir d’être accueillis par les représentants du Conseil des Professionnels de l’Hôtellerie et de leur présenter des premiers résultats en phase avec l’expérience vécue des managers et de rencontrer Stéphane Renard, conseiller au Ministère du Tourisme. Ce fût l’occasion de mieux comprendre la problématique économique et touristique : une croissance de 7% du nombre de voyageurs obtenue par l’ouverture de nouvelles lignes ( Frenchbee, United) créant de nouveaux flux de touristes dont une meilleure connaissance est clairement un enjeu. Les hôtels les plus importants n’en capturent que 2 ou 3%, au profit certainement d’autres formes d’hébergement : les pensions de famille qui connaitraient un épisode spéculatif et une professionnalisation qui pourrait les éloigner d’un modèle plus authentique et Airbnb qui semble gagner du terrain dans un contexte où le coût de la vie est très élevé, même pour des touristes aisés. On se verra aussi confirmer la prépondérance de Bora Bora et des motifs de lune de miel. D’autres rencontres avec des acteurs de terrain (Pensions et petits hôtels) nous aura appris l’importance des plateformes (50% de réservation via Booking pour l’un d’eux), le rôle des excursionnistes pour compléter l’expérience de séjour, mais aussi la gestion des approvisionnements. La toile de fond reste la durabilité, l’eau n’est pas partout disponible, la densité de tourisme fait question dans certaines iles, la question de la rencontre avec les populations est cruciale. La spécificité de la Polynésie en dépit de ses apparences de jardin et de son immensité (vaste comme l’Europe), réside dans la rareté de la terre, de petites populations et l’hétérogénéité des infrastructures.

La grande question réside dans la connaissance de ce qui détermine la production de ce type de contenu: quels effets des plateformes et de leur design sur le sentiment et les thématiques? On aura ainsi noté une chute de la production sur TripAdvisor et nous nous interrogeons sur les mécanismes de filtrages et de détection des faux avis. Quels effets des contributeurs qui diffèrent par leurs compétences langagières et leurs expériences de voyage? Un des résultats provisoires de nos analyse s montre ainsi des relations intéressantes entre le sentiment exprimé et le style d’écriture : les commentaires positifs sont plus courts et plus expressifs, les négatifs plus détaillés et plus neutre. Est-ce le résultat d’un biais d’approbation sociale? Quels effets enfin exercent les objets d’évaluation : activités, restaurants, les hôtels, excursions, rencontres, spectacles, couchers de soleils, le lagon, des jardins de corail, les baleines, la vie du Motu. Différentes facettes de l’expérience polynésienne, sans doute façonnées par les mythes, celui du paradis sur terre aux archipels chimériques, celui de la pieuvre qui réunit de ses bras les archipels du triangle polynésien.

La prochaine étape du projet va être une première généralisation. Avec Pierre Ghewy à l’UPF, et Hiriata Brotherson au Cetop, et l’aide des étudiants de la licence informatique, et de Jean-Baptiste Agostin à Paris, il s’agit d’abord de finaliser un premier corpus opérationnel (Tripadvisor+ Twitter+Airbnb), ensuite de tester sur ces données nos modèles et certaines de nos hypothèses en comparant deux sous-ensembles de commentaires : ceux relatifs à l’expérience de Bora-bora et ceux relatifs à celle de Tahiti, en contrôlant par la nature des hébergements.

Rendez-vous en septembre pour présenter les résultats et la méthode (On en a présenté les principes et des éléments de code aux étudiants de l’Ecole Doctorale de l’UPF). On les déposera progressivement sur notre compte Github. (quelques éléments préliminaires sont cependant disponibles sur r.benavent.fr ), le voyage ne fait que débuter.

Annexe : UPF conférence pour tous : ” Les commentaires des internautes, nouvelle source de connaissance des consommateurs“. On y présente des premiers résultats et les grandes questions qui traversent la recherche. et une interview dans TahitiInfo.

Cette page désormais concentre les ressources de nos ateliers r. Ce sont des carnets de recherche en Markdown qui réunissent sur une seule page html, les données, le code, les résultats et leurs analyses … et permettent de satisfaire aux nouvelles exigences de la “reproducibility” .

En voici les premiers qui nourrissent les cours que j’anime cette année à Nanterre et ailleurs, ils sont localisés sur le sous-domaine r.benavent.fr, comme de simples pages html. On y rattache bien sur tex2.r, le blog de nos explorations textuelles.

Pour participer aux ateliers, il est demander aux étudiants d’installer r, puis RStudio qui est l’environnement de travail. Ils sont encouragés à installer les packages requis à l’avance avec Rstudio (voici un tutorial). Rcmdr est sans doute le premier package à installer, il permet de disposer d’une interface graphique analogue à celle de spss et facilite la prise en main de r. On utilisera largement le markdown avec son augmentation bookdown.

les carnets de notes se retrouvent sur cette page, mais surtout on développera plutôt sur le compte github.

Sur Canal U , aux journées nationales du Management, le 13 novembre . Il y en a pour 79 minutes. C’est la suite du papier publié dans économie et management (n°168, juin 2018) ” méthamorphose digitale du marketing”, un complément. Les slides sont disponibles ici.

Objectif : rédiger une note de deux pages présentant une méthode d’analyse en marketing et utilisant des ressources r. Elle sera, si très satisfaisante, ajoutée à tex2r.

Objectif : rédiger une note de deux pages présentant une méthode d’analyse en marketing et utilisant des ressources r. Elle sera, si très satisfaisante, ajoutée à tex2r.

Elle sera rédigée en markdown (format d’export html) dans Rstudio. Elle comprend donc le texte explicatif, le code, et ses résultats. On y attachera le jeu de données.

Epreuve alternative : reprendre le document <AnalyseValeurs.rmd> (markdown) et compléter l’analyse sur l’un ou l’autre des points abordés ( commentaire, code supplementaires , variables additionnelles). Son résultat est disponible dans le fichier <AnalyseValeurs.pdf >

Date rendu : 10 janvier 2019

Sujets :

-

Les voyages sont faits pour être vécus mais ce qui en reste ce sont des mots. Des livres de voyageurs, le journal de bord des marins, et aujourd’hui le commentaire des expériences de consommation. A l’heure du post-exotisme ( pas celui-ci), quand le touriste pense rencontrer une culture authentique mais bien souvent façonnée par son propre regard, ce qui compte est moins ce que l’on a vécu que ce que l’on en garde : des selfies et le commentaire des lieux de séjours. C’est certainement moins poétique que Cook et Gauguin, mais plus profitable pour l’industrie du tourisme.

Et c’est à l’occasion d’un de ces voyages, avec l’aide des collègues du Cetop, des étudiants du master de marketing de l’UPF, et l’écoute du team de Tahiti tourisme, que nous nous sommes lancés dans l’analyse des sentiments exprimés par les touristes à propos de leur séjour avec une petite incursion dans les packages de text mining de r. Il n’y avait pas de meilleure place pour apprécier la critiques des auberges du paradis.

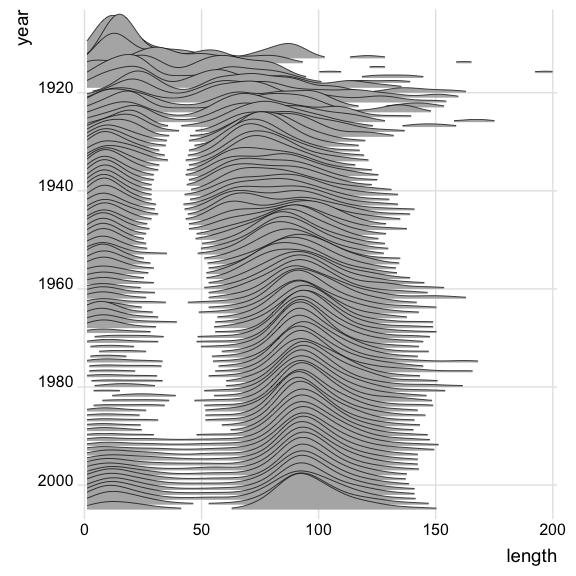

Pour la méthode, il s’agit d’abord de scrapper, avec les ressources du package rvest, le site de TripAdvisor. La Polynésie est isolée, trouvant ses clients dans trois grands bassins à plus de 10h de vol : l’Asie , les EU et la France. Il y a environ 150 hôtels et 300 pensions. Les résultats donnés dans cette note, sont établis sur la base d’une première extraction centrée sur Tahiti et portant sur 7700 commentaires. On généralisera plus tard sur les 77000 commentaires sur l’ensemble des archipels.

Ce corpus fait l’objet de deux types d’analyses comme on commence à le faire systématiquement dans ce type d’exercice : mesurer la tonalité positive ou négative (le sentiment) et les sujets évoqués ( topic analysis). Pour la première, on emploie tidytext, pour la seconde le modèle LDA du package Topicmodels.

Voici la présentation de travail (demo), avec quelques éléments de code, rendez-vous au piurn 2018 pour une présentation plus complète.